�й���������������Ӫ���������ܾ��� ����

�˹����ܼ�������ǰ��δ�е��ٶ�����ȫ�ø�����������ģʽ���ҹ��߶������˹����������־��õ�����ںϣ�2025��������������ǿ���������ƽ����˹�����+���ж�,�����ּ������������ơ��г����Ƹ��ý������,֧�ִ�ģ�㷺Ӧ�á���Ϊ����ҵ�����ǻ�ת��ָ���˷��Ӽ������ƿ����˹��������������ģ̬�����������������ܹ�����������չ��2025�괺��ǰ��DeepSeek���������ܿ�Դģ��V3/R1������û��ר��ģ��(MoE)�ܹ�������ɱ���ΪOpenAI��1/55���߱�ȫ�����ȵ�NLP��ģ�����������գ���Ϊ�Ƴ�CloudMatrix���ڵ㼼�������ô��µ�UB����������384�ŕN�ڿ����һ������ͳһ�ĸ����ܼ��㵥Ԫ��Ϊ���ģѵ�������������ṩ�˹����������ϡ���Щ���¼�������������˹����ܼ��������ɿص����ģ��ƶ��˽��ڴ��ೡ��Ӧ�õı�����

�ڴ˱����£��ʴ������ԡ��Ƽ����С�Ϊ���������ǰ����ȫ��AIս�ԡ�һ���棬������Ӧ���ҡ��˹�����+���ж����٣��粿�žۺ�ȫ��AI�����Ŷ�;��һ���棬��Ӫ����������ǰ�滮����ȷ���Լܹ�Ӧ�Դ�ģ�ͼ�����չ���̵IJ�ȷ���ԡ�Ŀǰ���ʴ�������ǧ����Ⱥ��Ͷ�����ڶ���ǧ����Ⱥ���ڽ����С�2025�괺�ں��ʴ����е�һʱ�䲿������ʮ��DeepSeek��ͨ������Ӧ��Ϊȫ��20����Ա���ṩ���ַ���������һ������Ӧ�ó����Ĺ�����ͨ���̹š�ǧ�ʵ������ģ��ʵ��������������˻�����ģ̬ͼƬ��Ϣ��ȡ������Ԥ�����ܳ��ʴ�����AI���ٶȡ�

һ������ʱ���������ı��

AI�����ڽ���ҵѸ�����Ե������ģ��Ӧ�ã���������ҵ����ʽ������������ΪAI������ʩ�ĺ������壬�����ܻ�ת�͵Ļ�ʯ�������������IJ��Ǵ�ͳ�������ĵļ��������죬����һ��ȫ��λ�ع����ӹ�ȥ�ġ���Դ�������ġ�������ġ���ֵ�������ġ����Ӵ洢���ݡ�֧��Ӧ�õ��ṩ��ͨ��+���㡱����������AIѵ�����������������ݷ��֣��ٵ�����������ܹ����㸴��������������Ҫ�Ժͼ�ֵ�����ԡ�

1.�ƻ������������������������ݽ�

�������꽨�裬�ʴ�������Ӫ���������Ѿ�ʵ������ҵ��100%�ƻ���ͨ��������ƽ��������������洢��������ƹ�ƽ̨���������ע�ؿ���չ�ԡ�����ԺͿɿ��ԣ�����ȫ��400���Ӧ�õIJ����ȶ����С�����������������Ҫ�����˹����ܼ���Ӧ�����ݹ���Ҫ��������ܹ���Ҫʵ�ֶԵȼܹ��������ģ�Ͳ��м���Ҫ���Ա��ϴ�Сģ�͵�ѵ�����������ģ��������ΪĿ�꣬��ǿ���ֲ�ʽ���м�����������ϰ����ٻ�����ͬʱ��Ҫǿ������ݴ�����������ʵ�����ݷ��ּ����ٵ����ݼ����ͷ�����

������������������˴��ģAI��Ⱥ�������豸�������Ӧ�ĸ��������ƴ�ͳ���ģʽ�����ø�Ϊǰհ�IJ���˼·��ͨ����ѧ�����Ĺ滮����ƣ�ȷ��������Ӧ����ȴϵͳ����������֮��ĸ�ЧЭͬ������������Ч��

������������δ���ݽ��ɷ�Ϊ�����Σ���һ�����������ģ�ͼ�����صĹ�ģͶ���Ρ����Ÿ�������ģ�͵�ӿ�֣����ͽ�����ҵ��չ���ģ��������ʵһ��AI��������һ�������������ͨ��������п��ٸ��죬�����Ż��ķ��似���Լ���UPS+HVDC������ģʽ����������Эͬ��AI��Ⱥ���衣�ڶ�������������Ρ����ſ����ŶӶ�AI�������յ������������Լ�Խ��Խ��ҵ���Ŷӵļ��룬AI������������Σ���ʱAIӦ��ռ�Ƚ�������ͳӦ�ã��������Ľ���Խ��Խ���ظ����ܼ�Ⱥ������Ч��ģ����ǿѵ�������ڵ㽫�����ģʹ�ã�����ģʽҲ���ݱ�Ϊ��Һ���ģʽ�������ü��ɻ��̶ȸ��ߵĵ���ģ���������������ĵ���������������AI�㷺Ӧ�ýΡ�Ԥ����2030��ǰ��AI���������ڣ���Ϊ����ҵ�ı�����ʱ�������Ľ�ȫ�����������������ת�ͣ�ͨ������ʽ���ģ�����Ч�ij��ڵ㣬���似��Ҳ��ȫ��ת��Ϊ���ʽҺ�䣬�����ý�ֱ�����ģʽ���㺣����������

2.��������������Ҫ��������������ں�

���������������ij�������ҵ���ǻ�ת�͵ĺ���ҵ����ʲ�����Ҫ��ֿ�������������ںϣ�һ�������ͨ����ںϡ�������Ҫ��ͨ��ͳһ���ǣ����ݹ��̡�RAG�ȶ��벻��ͨ����Դ��ʵ�������Ҫ��ֿ������ߵ���ϣ����������ƶ�����ȴ�������ѵ���ںϡ���ͬһƽ̨��ͬʱ֧��ѵ������������ʵ����Դ�������������Ч�ʡ����Ƕ�ģ�ںϡ���ʵ��Ӧ����������Ҫ���ģ��֧ͬ��һ��������AI��������˽�����������������Ҫ�߱��缯Ⱥ�������ĵĸ�Чģ�ͷ��ʺ�ģ�ͷ���߿ɿ�����������

3.���ģAI�����ƶ������������Ľ���

�˹����ܵķ�չ�������Ӹ�֪����֪�ٵ��ж�������ԾǨ���ڽ���ҵ��AI����������ԾǨ���ع����ڷ���ʽ���ı��ȥ��ģ�͵��������Ƭ�����棬�ӳ���ά��Ϊ����ҵע���µĻ��������磬��������������ڴ�ģ�͵����Ժϳɼ�����ʵ����������˻���֧�ַ��Ժ��ض���ɫ��ģ�⣬��ȫ�������ͻ����顣����AI��������ЧӦ���������˽��ڷ������̣������������ն������桢�㷨���еȴ���ҵ̬���ƶ�����ҵ�ӡ���������������֪�������ķ�ʽԾǨ����־��AI���Ӻ�̨֧��ϵͳ�ݱ�Ϊ���ڴ��µĺ������棬��ʢ����������������������ĵ��ݽ��ͽ��衣

�����ʴ����������������Ľ���ʵ��

�ڿ��ٵ�����AI��������У������������������������⣺

һ�ǻ�����������ì�ܣ�����ͨ��Ĵ�ͳ������α������㼯Ⱥ�Ĵ��ģ��أ�

���������볡����ì�ܣ��������ܳ���������ʢ��������Ȼ��ϡȱ��Դ�������Ч��������Ч��?

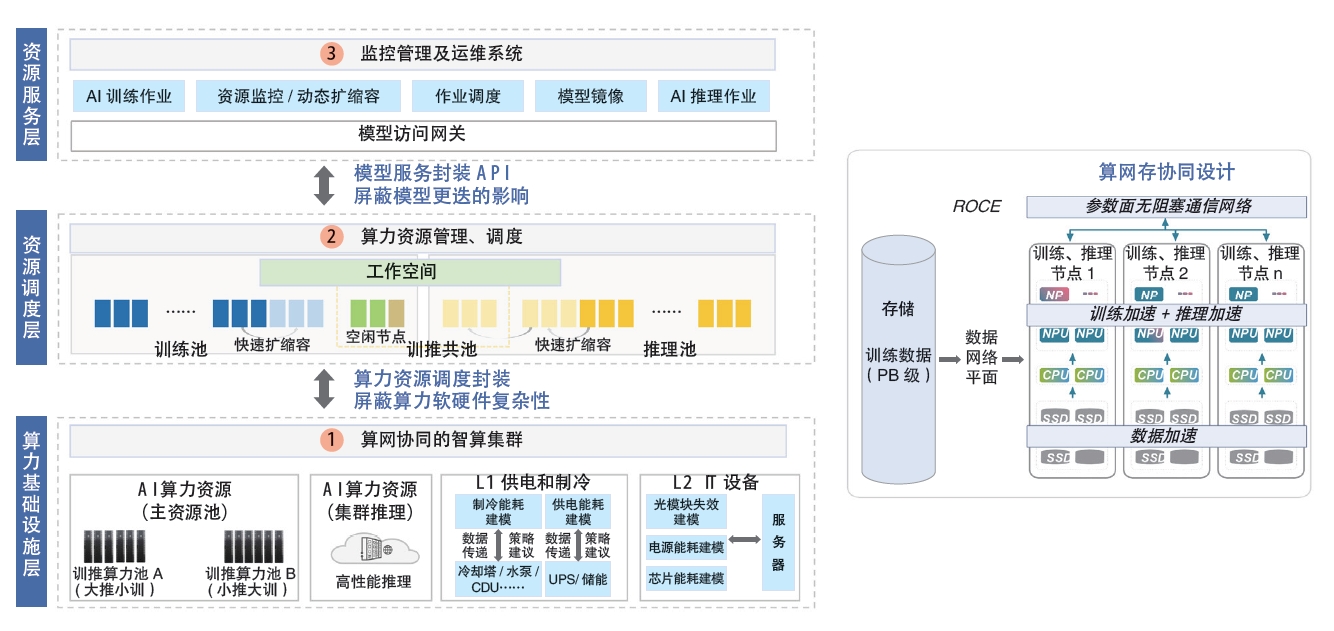

����ģ��Ӧ������ͳ�����ì�ܣ����Ŵ�ģ����ͷ������չ�������ʵ�ֽ��ڼ���ģ�ͷ���߿ɿ�?�����Щ���⣬�ʴ�������Ӫ�������IJ��ÿ��ݽ��ܹ���ƣ�ͨ������ܹ������ɳ����ݽ��ĸ�Ч������������(��ͼ1��ʾ)����ײ���ȫջ�����ɿص�����������ʩ�㣬�Դ�ͳ�����Ĺ��硢����ϵͳ�����Ż���ƣ���������Эͬ��һ�廯�ܹ��������ģ�ͷֲ�ʽ���м���Ҫ��;�м����������Դ���Ȳ㣬�ܹ�����ʵ����Դ����͵�����ͨ����ʱ���������Դ�����ʣ�Ϊʹ���������˵ײ������ʩ�ĸ�����;���ϲ�����Դ����㣬�ṩѵ�ƹ����б�Ҫ���Ʒ��ߣ�ͬʱͳһ��װģ�ͷ������أ��ܹ�ʵ��ģ�͵ĸ��ؾ��⡢�Ҷȷ���������ģ�ͷ���ĸ߿ɿ�������ģ�͵������滻ʱʵ��Ӧ���С�

ͼ1 �ʴ����������������ļܹ�

1.����������ʩ��

(1)������Ⱥ��Ƽ���������

��ģ��ʱ����Ӧ�ú�Сģ��ʱ����������ͬ��Сģ��ʱ��ģ�ͺ�������ɢ�ڸ�Ӧ��ϵͳ�����ģ��ʱ��ģ�ͳ�Ϊ��Զ����ķ���㣬����������Ҫ���в��������ģ�͵�ѵ������Ϊ�ˣ��ʴ�������Ӫ�������IJ��ñ�����������Ⱥ��ƣ�������Ŀ���Ϊ���ࣺһ���������ģ��ѵ�Ƶ�����Դ�أ�����Ⱥ����չ��ǧ������;һ���DZ���ǧ�ڼ�ģ�͵���ʱ��Ӧ�������������߲�����������Ⱥ������Ⱥ����չ��384��������ϣ����á�2+1���ܹ���������ǧ����ģ������Դ�ؾ�����ѵ�ƹ��ط�ʽ�����У�һ����λΪ����Сѵ��һ����λΪС�ƴ�ѵ������ؼ���������Ϊ���࣬ͬʱ����һ������������Ⱥ����������DeepSeek��Ѫ��Ĵ��ģ����������߾��ȵ�������˼ά�����ݺϳ�����

(2)�����������������Ż�

������Ⱥ��������Ⱥ���ּ�Ⱥ�ڲ���������ø�����ROCE/UB����ȷ�������ĶԳ��ԣ�ʵ�ִ�ģ�͵Ŀ������𡣴�ģ��ͨ���Եȼܹ�ʵ�ֿ���翨�ĸ����ܲ��м��㣬��˸����ܲ��������������ʵ��������Ϊ��Ҫ���ʴ�������Ӫ�������IJ���200GROCE����ʵ��ǧ����Ⱥ�ĸ��ٻ�����ͨ������Эͬʵ�ֶ�HCCL����ͨ�ŵĸ�֪��ͨ����̬���ؾ������������̵ľֲ�ӵ�������ż����ķ�չ�����ڵ㼯Ⱥ�����������缼������UBʵ�ֿ�ڵ�HBM�����弶���ʣ�ʵ���˼��㡢HBM���ڴ�ijػ�����384�Ÿ�����AI�������ۺ�Ϊһ̨����������������Ч�������ģ��ѵ������Ⱥ���������ݺϳɵ�����������У��ʴ�������Ӫ�������Ľ��ʵ�ʹ����������ͨ���������������������������ͨ������ֱ��в���ģʽ����ͨ���������ô�ͳ����ģ�ͣ�������������оֲ����졣����ģʽ�����˸���ɱ��������˲���������IJ��߾��룬�����˼�Ⱥ�ȶ��ԡ�

(3)�����������Ĺ����Ż�

AI��Ⱥ�����뼯Ⱥͨ��ģʽ�����������Ĺ��ʲ������ȶ����أ���Ⱥ�����������Ƽ����10��������ͻ��ͻ���������ߴ�50%������ͨ����Ƽ��㳡���²����ʽ���4.3%���Դˣ�����ϵͳ��Ҫ��Ӧ���ʵļ��ٲ�������Դ�豸���������������س�Ƶ���У���ֹ����ϵͳ�������߳�����ѹ�Լ����Ƶ���ŵ硣

�ʴ����������������Ĺ���ܹ�����2N����ܹ�������֧�ֳ�Ƶ����150%;ͬʱΪ����NPU���н���ͬһ·��Դ����NPU���洢�������豸��ϲ�������ƽ�����ʡ�����������ء�ͬʱ��UPS����߱���ǿ�Ĵ��������Լ������л���гģʽ�ķ�г��������

(4)�����������������Ż�

�Է������Ϊ����ͨ�ü��������������������������ݽ������У��Ż�����ϵͳ�����㵱ǰ�����ͬʱ����Ҫ�����ʱԤ�ȿ���Һ������滮����֤���������Һ������ɸ���ʵ����������������Һ�����������ȷ���ɽ����ַ����������ΪҺ�������Һ��ĵ��ͷ���������塢��û���������֣����ģʽΪ����ҵ������ģʽ��Ŀǰ�������������Ļ������á�Һ��+�м�/���伶���ܿյ�����Һ��+AHU��������ܹ���AHU������߽��ܺͷֲ�ʽ�ܹ������ƣ�Ŀǰ�Ѿ���Ϊ�����������ĵ�ѡ��

�ڷ������ʱ���ʴ�������Ӫ�������Ľ�Һ��ϵͳ����IT����������100%�������ã�������ϵͳ����50%�������á������ÿɼ��ݷ�Һ��ȣ�����δ����ͬҵ����������������Ʒ�ĵ�������������IT�豸��ԭ�ȵ�̨����ڵ�����ΪҺ����������

��ʵ�ʽ�������У��ʴ�������Ӫ�������Ľ�Һ����ȴITϵͳ�������ʩ��ϣ�ʵ�ִ�Ӳ���������ϵͳ��ȫջ�Ż�;ͬʱ����AI�㷨ʵ��������ά����Ч������ͨ��AI�������Ž����ܺġ�AI�������Ųɼ��������������豸�������豸��IT�豸��ѵ������Ȳ�����ͨ���ܺ��Ż�ģ�͡���������Ԥ��ģ�͵�ʵʱԤ����ѹ������������·�������Ų��ԣ�ʵ���ۺ��ܺĵĽ��͡�

2.��Դ���Ȳ�

��Դ����������������������Ч�ܵĹؼ��ֶΡ�Ϊ����ȵ�ʵ����Դ�����䣬������Ŷ�Эͬ��ɳ�����AI����������ʴ�������Ӫ������������ˡ�ר����Դ�ء����ӳء������ռ䡱������Դ����ģʽ��ʵ����ģ��Ӧ�õ�������Դ�ĵ���ӳ�����������Ŀǰ���ʴ�������Ӫ�������Ľ�1024�����������ڵ�ά�Ȼ���Ϊѵ����Դ�غ�������Դ�أ�ϵͳ����Ա����������ר���ؼ���������ڵ����ȵĵ��䡣ÿ��ר���ذ��������Ȼ���Ϊ������ӳأ�ÿ�����ӳؿ�������������Ԥ����Դ����Դ���ޡ������ռ�Ϊ�û��ṩ��һ����֯����AI��Ŀ�Ļ�����ÿ�������ռ���Թ���������ӳ���֧����Ӧ�����������ݴ洢��Ȩ�������������ϸ���Ŀ����Դ�������Ŀ�Ŷ��ڵĹ�����Эͬ����һ�������ʵ������Դ�����������룬ͨ�����ӳ�ʵ����Դ������Ų��ת����ͬʱ�����ռ������˶��Ŷ�Эͬ�Ͷ���ѵ�������е�����

3.��Դ�����

��Դ������ṩģ��ѵ�Ʒ�������Ҫ�Ļ�����Դ������ͳһ�ļ�ع���ƽ̨�Լ�ģ�ͷ������ء���ع�������άϵͳ�߱�ȫ��·�������������ģ�����й�����NPU�����ʡ�HBM�����ʵȹؼ�����ָ�ꡣģ�ͷ������ؽ�����ģ�ͷ��ʵ�ͳһ��ںͱ�API����Ȩģʽ���Ӷ�����ģ������Ӧ�õ�Ӱ�졣��ģ�ͷ���߿ɿ����棬�ʴ�������Ӫ�������IJ������㱣�ϻ��ƣ�һ��������Դ���Ȳ��ṩ��ģ��ʵ���ĸ��ؾ�����������Ϊ���õĸ߿ɿ�����;��һ����ͨ��ģ�ͷ�������ʵ�ֶ�ģ�ͷ���ľۺϡ��Ҷ����ߺ������л����Ӷ���������ģ�ͷ���ĸ߿ɿ�������������

��������Դ��������ֵ���죬ʵ����������

���Ÿ����ģ�ͼ����ļ������룬�ʴ�����AI����Ӧ�ó��֡���ֱ�+������չ����ά���ٷ�չ���ƣ��ʴ�������Ӫ�������ĴӼ�����������ռ��ʹ��¼�����������ά��ʵ�ִ���Դ�������ֵ�����ת�䡣

1.������������ռ�

�ʴ�������Ӫ��������ͨ������AI������ʩ�Ļ�ȡ�ż����ÿ����������ɻ�ȡ��ʹ�úͼ���AI�����ٸ���ҵ���ºͼ�ֵ���졣�������������ĽǶ�ͳһģ�;������������ű���ÿ��ģ�;���������ϸ����֤�������Ż����ÿ�����Ա�����ע�ײ㸴���ԡ�������Աͨ����Ȩ���빤���ռ���ܻ�ȡģ�Ϳ�������������ı�Ҫ������ģ�;��������ع��ߡ�����IDE����־����ȡ�

2.���ٴ��¼�������

AI�������ٷ�չ����Ҫǰհ��̽���ؼ����ͼ��������ҵ��ʵ�ʼ��ٴ��¼������룬ȷ�����㹻�ļ�����������δ���������磬����DeepSeek��������ߴ�ģ�ͣ����������ҵ����Ҫ�����ÿ������������һ������ȫ�ߴ�DeepSeek��Ⱥ���ᵼ��ÿ����Ⱥ�IJ����������������ߣ�����Դ���ܸ��á�Ϊ�ˣ��ʴ�������Ӫ��������������̽������������Ⱥ���������룬�ۺϹ���������һ�����͵�������Ⱥ�е�������ŵ�ҵ����PD���롢KV Cache�༶����ȼ�����������IJ����������������ṩ���ѵ�ҵ�����顣

�ġ��������������������������������ԾǨ

��ȴ�ͳ�������ģ������������Ĺ�ģ����ҵ���Ϊ�����Ҽ������¸��졣�ʴ�������Ӫ�������Ľ�Χ��ȫ��AIս��Ŀ��ͳ����������������湹���������������һ�ǹ���ǿ��ļ���������˳ӦAI�����ķ�չ���Ƴ��������¼������ṩ���ܸ�ȫ��������ǿ��Ч�ʸ��ߵ�AI����ƽ̨;������������ƽ̨�ƶ����ŵĹ���AIоƬ��̬��ϵ���룬�����������³������;����Χ������ؼ��������Խ��á��úá��ܺ�����������ʩΪĿ�꣬�齨ר���Ŷӣ������˲����������롣�ʴ�������Ӫ�������Ľ�ͨ����������̬���˲������������裬�����ʴ��������ǻ�ת������ʵ������������ԾǨ������AI������ʵ��Ϊ�������������ֵ������ؼ����⡣

|